반응형

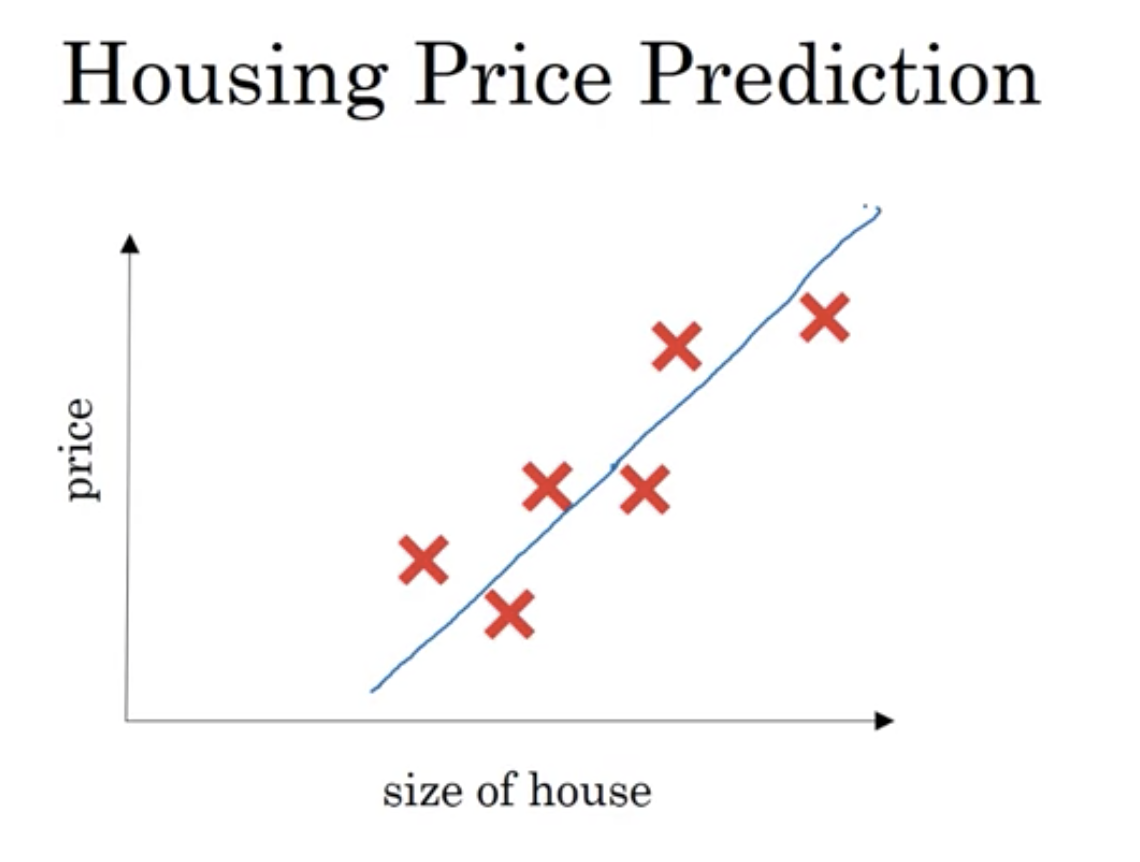

Housing Price Prediction에서 보면, linear Regression의 형태로 이루어지는 걸 볼 수 있습니다.

Deep Learning의 관점에서 보면, 하나의 Neuron을 여러 개로 연결하는 형태로 이루어져 있는 걸 볼 수 있습니다.

이 경우에는, 하나의 Neuron(신경)만 사용하면 될 거 같네요.

하나의 뉴런에는 인풋과 아웃풋이 있고, 그 인풋과 아웃풋을 연결하는 함수를 Activation function (활성화 함수) 라고 합니다.

Activation function에는 여러가지가 있지만, 가장 많이 사용하는 것은 RELU(Rectified Linear Unit)입니다.

Relu, Sigmoid, Step function등 여러가지가 있고, 나중에 정리를 하도록 하겠습니다.

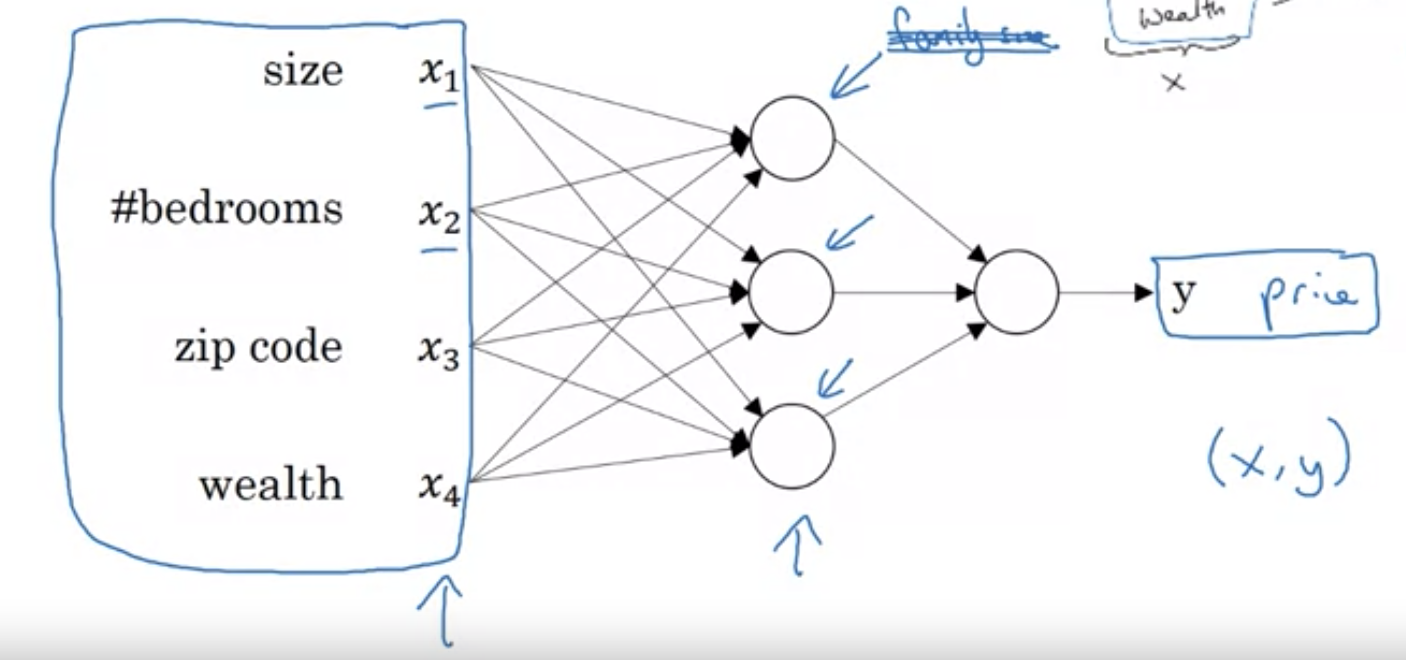

하지만 만약 인풋이 하나가 아니라면 어떻게 될까요?

그럴 경우에는 여러개의 인풋마다 하나씩의 뉴런이 할당된다고 생각하면 될 것 같습니다.

Input이 들어가는 neuron들로 이루어지는 걸 input layer라고 합니다.

마지막에 이루어진 layer를 output layer라고 합니다.

중간에 이루어진 layer를 hidden layer라고 하고, 그 사이의 구조를 어떻게 짜는지에 따라

딥러닝 아키텍쳐가 그려진다고 보면 될 것 같습니다.

반응형

'Machine Learning' 카테고리의 다른 글

| Gradient Descent(경사 하강)에 대해서 알아봅시다! (0) | 2022.02.18 |

|---|---|

| train test split 하는 커스텀 python 스크립트를 만들어봤습니다 (0) | 2021.12.23 |

| Regularization과 Normalization (0) | 2021.09.03 |

| Precision과 Recall, 그리고 f1 score (1) | 2021.06.03 |

| Bias(편향)과 Variance(분산) (0) | 2021.05.24 |